Kybernetická bezpečnosť a umelá inteligencia?

Úvodný obrázok zdroj: BrianPenny, Pixabay

So svetom, ktorý je čoraz viac digitalizovaný a s internetom, dostupným pre každého na akékoľvek účely, prakticky kedykoľvek, prichádzajú aj nespočetné pozitíva. Spolu s tým však vznikajú aj nové hrozby a potreba stále silnejších opatrení v oblasti kybernetickej bezpečnosti sa dostáva do popredia viac než kedykoľvek predtým.

Treba chápať, že kybernetická bezpečnosť sa stala kritickou témou pre podniky, vlády ale aj jednotlivcov. Obrovské kvantá citlivých dát, ktoré úprimne povedané už málokto uchováva v hmotnej forme. Takmer všetky sa nachádzajú v online priestore čím sú vystavené neustálej hrozbe.

Aj napriek stále zlepšujúcim sa opatreniam, sofistikovanosť útokov sociálneho inžinierstva ide ruka v ruke so zabezpečením. Kybernetické útoky spôsobujú finančné straty, poškodenie reputácie v krajných prípadoch aj smrť. Zároveň tu vznikajú aj náklady spojené s reakciou na útok, obnovenie systému, právne kroky a podobne. Dopad v prípade úspešného kybernetického útoku môže byť devastujúci.

Samozrejme sa môžeme baviť o dôležitosti ochrany kritickej infraštruktúry ako je energetika, doprava či zdravotníctvo. Následky spojené s prípadným útokom na ne si môžeme sami domyslieť.

Spoločnosť Equafax

Okrem finančných strát môžu kybernetické útoky poškodiť aj reputáciu spoločnosti a viesť k právnym a regulačným pokutám. Ako konkrétny príklad sa dá uviesť spoločnosť Equifax. Kybernetický útok na ňu spôsobil únik dát, ktoré odhalili súkromné informácie odhadom 143 miliónom ľudí. Spoločnosť sa ocitla pod paľbou kritiky. Spoločnosť čelila veľkému množstvu žalôb a zároveň zhruba 700 miliónovému vyrovnaniu s Federálnou obchodnou komisiou.

Heslo ako základný kameň bezpečnosti

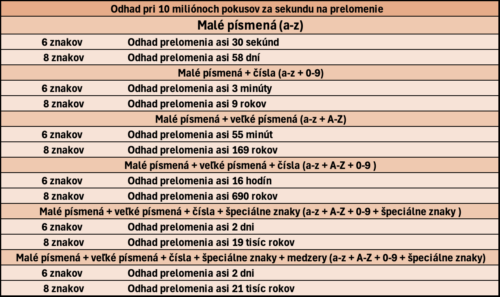

Základné odporúčané opatrenie napríklad pre jednotlivca, je používanie hesla, ktoré bude ideálne obsahovať aspoň 8 znakov, pričom sa využije kombinácia malých a veľkých písmen, čísiel a špeciálnych znakov. Samozrejmosťou by mala byť viacfaktorová autentifikácia. Opatrenia zahŕňajú aj šifrovanie, pravidelné bezpečnostné audity a podobne.

Tabuľka zobrazujúca odhad času na prelomenie hesla

Zdroj: vlastné spracovanie

Primárne výhody

Umelá inteligencia je spájaná s kybernetickou bezpečnosťou čoraz viac. Dôvodom toho je fakt, že táto technológia dokáže analyzovať obrovské kvantá dát a detegovať anomálie, ktoré môžu byť predzvesťou hrozby alebo hrozbou samotnou. Tradičné bezpečnostné metódy majú svoje obmedzenia.

Tým asi najpodstatnejším je fakt, že sú neschopné prispôsobovať sa rýchlo sa meniacemu trendu akým sa vyvíja prostredie kybernetických hrozieb. Fungujú na princípe, kde majú stanovené pravidlá, podpisy, heuristiky na detekciu a prevenciu. Spôsobom fungovania však postavený na už známych hrozby a miesta zraniteľnosti, ktoré sú vopred definované na základe skúseností. Tým sú veľmi ľahko priechodné v prípade „zero-day“ útokov, ktoré sú pre tento systém doteraz neznáme. Ďalej sa tú dá hovoriť, že reagujú zväčša až po samotnom útoku, nie počas neho. Taktiež tvoria množstvo falošných „poplachov“, ktoré sú následne zbytočne preverované. Čím sa pracovníci v tomto smere len zahlcujú.

Vždy pripravený

V tejto časti si priblížime ako AI môže zlepšiť bezpečnostné opatrenia. To, že systém analyzuje dáta v reálnom čase a hľadá odchýlku už bolo niečo málo napísané. A však o pokročilej predikcií hrozieb zatiaľ nie. Tu sa využíva prediktívna analytika, ktorá skúma potencionálne hrozby skôr ako vôbec vzniknú. Historické dáta spoločne s identifikovaním vzorom, môžu systémy umelej inteligencie predpovedať potencionálne hrozby a okamžite prijať opatrenia na ich riešenie. Z toho vyplýva fakt, že AI systém je schopný reagovať na hrozby v reálnom čase a oproti tradičným spôsobom ochrany je „svižnejší“. Zároveň „otvorenejší“, keďže je pripravený neustále sa učiť z nových dát, prispôsobovať sa hrozbám, ktoré „nikdy nespia“. Zároveň týmto spôsobom sa zvyšuje presnosť a účinnosť systému.

Jedným a veľmi dôležitým prínosom aký prináša bezpečnostný systém, ktorý poháňa umelá inteligencia je schopnosť automatizovať úlohy a oproti bežnému spôsobu ochrany aj znižovať falošné poplachy. Čím aj bezpečnostné tímy nie sú zahltené neadekvátnymi náznakmi hrozieb.

Každá minca má dve strany

Doteraz svojím spôsobom bola umelá inteligencia len vyzdvihovaná a predstavované jej silné stránky a využiteľnosť a však každá strana má dve mince a inak to nie je ani pri tejto téme. Potenciál výrazne zlepšiť bezpečnosť tu samozrejme je a je ťažké to poprieť. A však je dôležité si uvedomiť, že algoritmy umelej inteligencie sa dajú charakterizovať ako „čierne skrinky“. Pri algoritmoch umelej inteligencie je problém s nedostatkom transparentnosti v tom ako fungujú. Z toho plynie, že je veľmi ťažko pochopiteľné ako algoritmus prijíma a uskutočňuje rozhodnutia.

Dá sa to pochopiť na jednoduchom príklade, ak AI nesprávne identifikuje určitú aktivitu ako hrozbu a definuje ju tak. Je veľmi náročné potom prísť na skutočnosť prečo sa tak stalo, čím sa oprava chyby môže stať veľmi komplikovanou záležitosťou.

XAI

Preto je potrebné tieto problémy vyriešiť aby boli systémy transparentné a zodpovedné. Riešením môže byť napríklad sprístupnenie rozhodovacieho procesu aby nevznikali situácie kedy človek nedokáže pochopiť prečo sa systém rozhodol tak ako rozhodol.

Tu sa dostávame k pojmu, respektíve skratke XAI, alebo aj umelá inteligencia, ktorá je pre človeka vysvetliteľná. Systém je schopný vysvetliť svoju aktivitu a rozhodnutia tak aby to bolo pre ľudí pochopiteľné.

Bez etiky to nejde

Obísť sa samozrejme nemôže ani etická stránka využívania umelej inteligencie v kybernetickej bezpečnosti. Dôvodov je mnoho a však ten úplne primárny je zásah do ochrany osobných údajov. V rámci to, že AI zbiera a spracúva množstvo dát, ktoré obsahujú osobné údaje môže tu nastať situácia, že dáta nebudú použité na účely, ktoré boli pôvodne zmýšľané. Príkladom môže byť situácia s technológiou rozpoznávania tváre kedy primárny účel bezpečnosti sa môže premeniť na sledovanie jednotlivcov bez ich súhlasu.

V tomto prípade, je vo všeobecnosti pri používaní AI v bezpečnosti nastaviť jasné rámce, ktoré budú vymedzovať etické a právne rámce.

Aká je budúcnosť?

A však aká je predpoveď budúcnosti bezpečnosti poháňanej umelou inteligenciou? Určite sa dá povedať, že svetlé a vysoký potenciál sa nedá poprieť. Samozrejme je potrebný ešte ďalší vývoj a stála implementácia inovácií. Je potrebné zapracovať na zvýšení automatizácie, čím by sa znížila potreba ľudského zásahu, keďže sa vo všeobecnosti počíta s tým, že počítač je menej „chybový“ oproti človeku. Dá sa tiež predpovedať, že tieto systémy budú prepájané s inými technológiami. Týmto by sa mohlo umožniť komplexnejšie a proaktívne bezpečnostné opatrenia.

Čo dodať na záver, AI v kybernetickej bezpečnosti má ako prakticky v každej oblasti, do ktorej sa implementuje potenciál obrovskej revolúcie. Využitím sily algoritmov strojového učenia môžu systémy zabezpečenia poháňané AI rýchlejšie identifikovať hrozby, automatizovať bezpečnostné úlohy a znížiť riziko ľudských chýb. Samozrejme visia vo vzduchu aj hrozby a rizika, ktoré treba zvážiť a vyvinúť spôsoby pre ich elimináciu. Je teda na záver dodať, že pokrok sa nedá zastaviť ani v tomto smere a však je potrebné aby aj tento systém dodržiaval etické prvky a nestal sa problém namiesto riešenia.