Etické aspekty umelej inteligencie 3

Úvodný obrázok zdroj: padrefilar, Pixabay – upravené

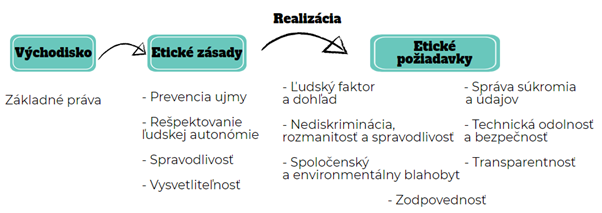

Pozrime sa spolu na etické požiadavky, ktorým sme sa venovali už v minulom dieli. Ak ste sa dostali rovno k tomuto pokračovaniu, pripomíname, že ide o dokument vytvorený skupinou zriadenou Európskou komisiou. Priblížme si teda posledné zo siedmich požiadaviek. Umelá inteligencia potrebuje mať definované etické aspekty, aby sa mohla v spoločnosti používať.

Správa súkromia a údajov

Zabezpečiť, aby citlivé vstupné dáta boli využité iba na primárny cieľ, a to natrénovať systém umelej inteligencie pre konkrétny prípad. Ochrana sa týka nielen dát, ale aj súkromia osôb, aby nedošlo na základe výstupov napr. k diskriminácii. Dohliadnuť, akým spôsobom sa dáta získavajú, overiť ich kvalitu a otestovať ich, aby škodlivé dáta nemali možnosť vstupu do procesov systému umelej inteligencie.

Samostatnou kategóriou je zriadenie práva, ktoré umožní len kvalifikovaným osobám prístup k systémovým dátam. V písomnej forme má byť jasne určené, kto a za akých okolností k nim môže pristupovať.

Zdroj: Tumisu, Pixabay

Technická odolnosť a bezpečnosť

Spolu s predchádzajúcim bodom súvisí so zásadou prevenciou ujmy. Umelá inteligencia by mala byť tvorená so zohľadnením možného rizika, keby sa v prípade zásahu (ľudským alebo umelou inteligenciou) mala umelá inteligencia zachovať nepriateľsky. V prípade takejto situácie by mali byť vypracované plány ako zasiahnuť. Mať na pamäti možnosť neúmyselného konania a prijať preventívne opatrenia pre situácie, kedy by ľudský zásah nebol možný. S použitím umelej inteligencie sa musí dbať na bezpečnosť v globálnom ponímaní. Pôsobenie umelej inteligencie nesmie mať negatívny dopad na človeka ani životné prostredie. Ani v interakcii s iným systémom.

Na zreteli treba mať aj riziko útoku a prijať preventívne opatrenia, v prípade útoku na dáta, softvér alebo hardvér. S tým súvisí aj zaistenie presnosti dát, keď v prípade priameho vplyvu umelej inteligencie nebol v dôsledku nepresných údajov ohrozený ľudský život.

Zdroj: Pete Linforth, Pixabay

Transparentnosť

V prípade komunikácie má človek právo vedieť, že komunikuje s umelou inteligenciou a mať možnosť odmietnuť komunikáciu v prospech komunikácie s človekom. Hlavne, ak by išlo o otázky základných práv. Ak sa umelá inteligencia zachová chybne, malo by byť ľahko vypátrateľné prečo. Na druhej strane, treba sledovať, či sa opakovalo správanie systému pri opätovnom pokuse za rovnakých podmienok, čo označujú pojmom reprodukovateľnosť. Na základe zdokumentovaných postupov, dát, vrátane ich získavania, by malo byť možné predísť opakovanému nevyžadovanému správaniu.

Zodpovednosť

Ľudia pochybujú o umelej inteligencii a posilnenie dôvery spočíva, podľa slov skupiny, v prijatých opatreniach, v rámci ktorých bude jasne definované použitie mechanizmov na nápravu. Audit je jedna z foriem, ktoré by mohli zabezpečiť pravidelnú kontrolu systému. Okrem mechanizmov vhodných pre nápravu by malo byť zabezpečené oznamovanie opatrení či rozhodnutí ako reagovať na konkrétnu situáciu s minimalizáciou negatívneho vplyvu. Ak by vznikla pri vývoji umelej inteligencie nezhoda pri vykonaní požiadaviek, treba mať pripravené kompromisy, ktoré sa v prípade konfliktu musia brať do úvahy. Ak by nebolo možné určiť kompromis pre etické požiadavky, vývoj či implementácia systému v danej podobe by mal byť zastavený.

Zdroj: vlastné