Strojové učenie formou odmeňovania v praxi

Možno ste počuli o tom, ako zvládla umelá inteligencia zahrať hru Super Mario bez akýchkoľvek inštrukcií a pravidiel. Ďakovať za tento „zážitok“ môžeme metóde strojového učenia formou odmeňovania (RL). Na čo je ale dobré, aby vedel „počítač“ vyhrať hru? Vedieť sa rozhodovať (na základe odmeny) a optimalizovať úsilie pre danú akciu v prostredí aj niekoľkých aktérov, ako to bolo pri Dote 2, je stratégiou ako byť úspešný aj v reálnych situáciách. Kde teda môžeme RL aplikovať?

Konfigurácia webových aplikácií

Nastaviť a otestovať optimálne nastavenie parametrov pri konfigurácií servera či webovej aplikácie, je neraz skutočná výzva. Pomoc však môže časom prísť za asistencie umelej inteligencie. Čínski nadšenci pre RL z Michigenskej univerzity vytvorili model automatickej konfigurácie parametrov, v ktorom bola odmena pri učení zadaná rozdielom zadaného a nameraného času odozvy aplikácie.

zdroj: 200 Degrees, Pixabay

Reklama a inzercia

Pomocou RL skúsil „okoreniť“ uverejňovanie reklamných príspevkov čínsky známy gigant Alibaba. Odmenou v tomto prípade boli získané príjmy z reklamy. Výsledky boli sľubné natoľko, že si naplánovali live testovanie na ich Taobao stránke.

Články na mieru

Ak ste skalný fanúšik futbalu, určite si o ňom radi niečo prečítate. „Vyskočil“ na vás článok na internete a „náhodou“ bol presne o tom, čo vás najviac zaujíma? Aj za personalizovaný obsah je zodpovedná umelá inteligencia. Môže však predvídať, že časom zmeníte preferencie a zameníte šport za technologické články? Čínski výskumníci aplikovali RL do modelu, ktorý dokáže namodelovať preferencie užívateľa tak, aby získal čo najvyššiu odmenu – kliknutie na daný článok. V ďalšom kroku sa chcú zamerať na to, aby motivovali čitateľa navštíviť stránku znova, čím by nešlo iba o jednorázové čítanie.

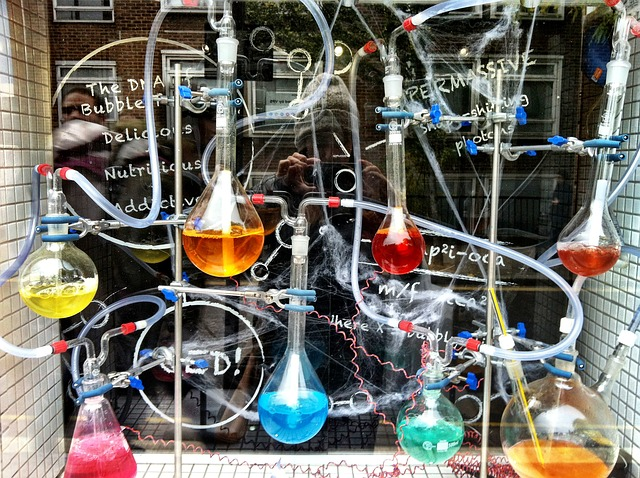

Chémia

Mohla by v prostredí, kde musíte sledovať, či zlúčeniny nevytvoria nežiaducu reakciu, pomôcť umelá inteligencia? Pri opakovanom sledovaní výsledkov chemických reakcií uplatnil tím zo Standfordskej univerzity model s použitím RL. Už v priebehu pol hodiny dokázal navrhnúť optimálne prostredie pre požadovanú reakciu. Odmenou v tomto prípade bola stavová funkcia.

zdroj: Chiara Tiberti, Pixabay

Robotika

Pri učení robota môže trénovanie jednoduchej činnosti neraz trvať aj niekoľko hodín či dní. Aby sa optimalizovalo úsilie, tím Kalifornskej univerzity v Berkeley použil vo svojom modeli okrem klasických algoritmov strojového učenia aj RL. Vďaka nemu sa robot naučil stratégii, ako má čo najefektívnejšie zvládnuť komplexné vizuomotorické činnosti.

Zdá sa teda, že hranie hier bolo štartovacou čiarou, aby tímy prinášali aj užitočné riešenia s pomocou nedoceňovaného RL.

Zdroj:

https://towardsdatascience.com/applications-of-reinforcement-learning-in-real-world-1a94955bcd12